きむら

きむら虹色になってるやんけーーー!ChatGPT5は5次元(パラレル)モデルですねきっと

目次ひとつに統合されたシステム

GPT‑5 は、2つのモデルとルーター機能からなるシステムです。1つ目のモデルは、高速かつ効率的に幅広い質問に回答できる高速応答用モデル(高スループット)、2つ目のモデルはより複雑な問題に対して複雑問題用モデル(深い推論)(GPT‑5 thinking)です。そして、最適モデルを自動選択するリアルタイムルーター機能が、これら2つのモデルのどちらを使うべきか、会話の種類や複雑さ、必要なツール、ユーザーが示した意図(例えば、「深く考えて」など)に応じて、瞬時に判断し、切り替えてくれます。ルーター機能は、モデル切替のタイミング、回答満足度、正確性などのユーザーの利用データを学習し、精度を向上させます。なお、使用上限に達すると、各モデルの mini 版が質問に対応します。近い将来に、これらの機能を1つのモデルに統合することを予定しています。

出典:OpenAI – GPT-5 が登場

8月7日にChatGPT5が発表されましたね!個人的にはワクワクが止まらない!!です。

ついに人工知能が人を超えた!とのことですが、一体どのような点で超えているのか。我々のことをどのようにサポートしてくれるのか。楽しみです。

察する力も強化されているようですが、我々は更に語源力と専門性を極めなければならないですね。

というか、プロンプトでwindows95~XP時代を思い出すようなプログラム作っちゃっている辺りもすごいですね。

現時点ではまだプロンプトする人が必要そうですが、いずれ物理的な人工知能モデルみたいのもできて、AI同士で役割分担するんじゃないですかね。(人間いらない説)

ただ、AIには時間的概念がない(劣化や老化などの物理的な変化がない)のでその辺りだけは理解は難しいんじゃないかなと思います。

現時点でwindows95~XPってことは2年後くらいにはWindows11ははるかに超えてますよね。イメージが付きにくい表現かもですが、現時点の人間開発レベルははるかに超えてるんじゃないかなと個人的には思っています。

なので、専門性の高い人間が監修に回って、お仕事はほぼAIになるんじゃないかなみたいなイメージです。爆速で専門性極めないとまずいですね(笑)

試してみました。

JSのコード出力が出来ると思いますが、言葉で、こういう動きのものをwordpressのSWELLテーマで実装したい!といったらしてくれますか?

手順とコードと最終結果を図解で表記してほしいです

できますよ!

「こういう動きのものをSWELLで入れたい」と文章で書いてくれれば、要件を噛み砕いて手順・コード・図解までまとめます。まずはイメージ合わせのために、サンプルとして――“スクロール時にふわっと出現+うっすらパララックス” をSWELLで実装する流れを見本提示します。必要ならこのまま使えますし、あなたの希望に合わせて調整もできます。

進め方(実案件フロー)

- あなたがやりたい動きを文章で説明

例:「セクションがビューポートに入ったら0.4秒でフェードイン、見出しは少し上に浮きながら」「PCだけ発火」「1回だけ再生」など - 私が要件→設計に落とし込み(トリガー条件/再生回数/対象ブロック/レスポンシブ条件)

- 実装コード(HTML/Block設定、CSS、JS)を納品(SWELLに最適化)

- 図解とテスト項目を添付

- 必要ならアクセシビリティ・パフォーマンス調整まで

サンプル実装:スクロールで“ふわっ”+軽いパララックス

1. どこに置く?

- CSS:外観 > カスタマイズ > 追加CSS(または子テーマの

style.css) - JS:

- 子テーマの

functions.phpで読み込み、または - プラグイン「Code Snippets」に登録してフロントで実行

- もしくは「フッター直前コード挿入」系エリアがあればそこに

<script>...</script>

- 子テーマの

※SWELL本体は直接編集しないのが安全。子テーマ or Code Snippets推奨。

2. ブロック側(HTML/設定)

Gutenbergの各セクションやカラムに追加CSSクラスとして js-fadein を付けるだけ。

(見出しだけ強めに動かしたい場合は js-fadein-head を併用)

- 例:カバーブロック → 追加CSSクラス:

js-fadein - 例:見出し(H2) → 追加CSSクラス:

js-fadein js-fadein-head

3. CSS(初期状態とアニメ後)

/* 初期状態(非表示・下から少し) */

.js-fadein {

opacity: 0;

transform: translate3d(0, 24px, 0);

will-change: transform, opacity;

transition: opacity 0.6s ease, transform 0.6s ease;

}

/* 発火後(表示・位置リセット) */

.js-fadein.is-inview {

opacity: 1;

transform: translate3d(0, 0, 0);

}

/* 見出しは少し強めに */

.js-fadein-head {

transform: translate3d(0, 32px, 0);

}

.js-fadein-head.is-inview {

transform: translate3d(0, 0, 0);

}

/* パララックス用(子要素がほんのり上へ) */

.js-parallax-child {

transition: transform 0.6s ease;

}

.is-inview .js-parallax-child {

transform: translate3d(0, -6px, 0);

}

/* ユーザーが「動きを減らす」を設定している場合に配慮 */

@media (prefers-reduced-motion: reduce) {

.js-fadein,

.js-fadein-head,

.js-parallax-child {

transition: none !important;

transform: none !important;

}

.js-fadein,

.js-fadein-head { opacity: 1 !important; }

}JS(IntersectionObserverで一度だけ発火/再入場でもOKに切替可)

<script>

(function(){

// 設定

var once = true; // true=一度だけクラス付与、false=出入りで付け外し

var rootMargin = "0px 0px -15% 0px"; // 下側少し早めに発火

var threshold = 0.2; // 20%入ったら

if (!("IntersectionObserver" in window)) {

// 古いブラウザは即時表示

document.querySelectorAll(".js-fadein").forEach(function(el){

el.classList.add("is-inview");

});

return;

}

var io = new IntersectionObserver(function(entries){

entries.forEach(function(entry){

var el = entry.target;

if (entry.isIntersecting) {

el.classList.add("is-inview");

// 一回限りの場合は監視解除

if (once) io.unobserve(el);

} else {

if (!once) el.classList.remove("is-inview");

}

});

}, { root: null, rootMargin: rootMargin, threshold: threshold });

document.querySelectorAll(".js-fadein").forEach(function(el){

io.observe(el);

});

// 軽いパララックス(視差:子要素を少しだけ動かす)

// スクロール量に応じて data-parallax-speed (0~1) で調整

var rafId = null;

var parallaxEls = Array.from(document.querySelectorAll(".js-fadein .js-parallax-child"));

function onScroll(){

if (rafId) return;

rafId = requestAnimationFrame(function(){

rafId = null;

var vh = window.innerHeight || document.documentElement.clientHeight;

parallaxEls.forEach(function(child){

var parent = child.closest(".js-fadein");

if (!parent) return;

var rect = parent.getBoundingClientRect();

if (rect.bottom < 0 || rect.top > vh) return; // 画面外はスキップ

var center = rect.top + rect.height/2;

var prog = 1 - Math.abs((center - vh/2) / (vh/2)); // ビューポート中心に近いほど1

var speed = parseFloat(child.getAttribute("data-parallax-speed") || "0.15");

var offset = (1 - prog) * 12 * speed; // 最大12px程度

child.style.transform = "translate3d(0," + (-offset) + "px,0)";

});

});

}

window.addEventListener("scroll", onScroll, { passive: true });

window.addEventListener("resize", onScroll);

onScroll();

})();

</script>使い方メモ

- パララックスをかけたい子要素にクラス

js-parallax-childを付与し、強さはdata-parallax-speed="0.2"のように調整。 - PCだけ有効にしたいなら、JSの先頭で

if (window.matchMedia('(max-width: 767px)').matches) return;のように条件分岐。

図解

テストと微調整(チェックリスト)

- 1回だけ再生?再入場で繰り返す?

onceで切替 - 発火タイミング:

rootMargin/threshold - モバイル無効化の要否(狭い画面での多用は体感悪化のことあり)

prefers-reduced-motionで動き軽減に対応- CLS対策:初期状態で高さが変わらないスタイルに

- 画像の遅延読み込み(SWELL標準のLazyLoad)と干渉しないか

ここからあなたの番

やりたい動きを言葉でください。

例:

- 「スクロールに合わせて左からスライドイン、遅延0.2sずつで3要素」

- 「ファーストビューでヒーローテキストがタイプライター風に」

- 「カードがホバーで少し浮き、影が強まる」

- 「特定のセクション到達で数値カウントアップ」

要望をもらえれば、SWELLに最適化した手順・コード・図解をあなたの仕様に合わせて作り込みます。遠慮なく細かくどうぞ!

結果論これで想像通りの実装が出来ればいい訳です。元々JSが出来る人であれば、更に細かく指定ができて、最適化されたコードが書けますね。これからの専門家は監修になる時代ですね。

多分この辺りならChatGPT5じゃなくて4でも出来ると思うのですが、具体的に5で何が変わるのかChatGPT5に訊いてみました。

ChatGPT5で何が変わる?

具体的に今までとは何が変わりましたか?

質問の「今までとは何が変わりましたか?」は、

何に対しての変化かが明確でないので、まず対象をはっきりさせたいです。

例えば、聞きたいのが…

ChatGPT の機能や応答の変化

法律・制度・税制の改正

あなたのビジネスや生活環境の変化

社会や市場の動向の変化

…のどれにあたるかによって、説明の内容も全く変わります。

どの「変化」について知りたいか、対象を教えてもらえますか?

そうすれば、以前との比較を具体的に時系列で整理してお答えできます。

今まではこっちの言いたいことを勝手に想定して解答くれてた気がするけど、より明確な解答出す為に聞き返してくるようになった点も変わって気がする…

ChatGPT4とChatGPT5では何が明確に変わるのか具体的に教えて頂けますか?

ChatGPT‑4と最新のChatGPT‑5の間には、設計思想やユーザー体験、性能面で明確な進化が複数あります。以下に、具体的な変更点を整理してお伝えしますね。

ChatGPT-5の主な進化ポイント

1. 飛躍的に賢く・正確に・高速に

- ChatGPT‑5は「博士号レベルの専門家のような応答」を目指し、速度や精度、信頼性が大幅に向上しました WIREDThe AtlanticThe Vergeバロンズ。

- **ハルシネーション(誤情報の生成)**が減り、自分の限界を理解して「わからない」と明確に応える能力が強化されています Hindustan TimesThe Vergeバロンズ。

2. 高度な推論と「思考時間」機構

- 複雑なタスクではより多くの計算リソースを割いて説明力や正確さを高める「思考モード(GPT‑5‑thinking)」が追加されました Passionfruit+1。

- 自動ルーティングによって、タスクの複雑さに応じて最適な処理モデルが選ばれ、ユーザーがモデルを意識する必要がなくなっています WIREDThe VergeIndiatimes。

3. マルチサイズ化と柔軟なAPI

- APIでは「標準・ミニ・ナノ」の3サイズのGPT‑5が提供され、用途による性能・コスト・応答速度の最適化が可能です powerdrill.ai+2OpenAI+2。

4. 高度なマルチモーダル&コンテキスト対応

- テキストだけでなく、画像・音声・動画まで統合処理できる「本格的なマルチモーダル対応」が進化し、GPT‑4oの延長線上と言える進化を遂げています El PaísCinco Días。

- コンテキスト窓が拡大し、「1ミリオン以上のトークン」が扱えるようになりました(比較:GPT‑4では128k など) El PaísCinco Días。

5. 個性と統合エクスペリエンス

- インターフェイスのカスタマイズが可能になり、性格(パーソナリティ)や色分けなど、より親しみやすい体験設計が提供されます バロンズEl País。

- GmailやGoogleカレンダーとの連携も追加され、AIがより個人に寄り添った形で振る舞うようになりました バロンズEl País。

6. エージェント的な統合能力の強化

- ChatGPT‑5は従来の複数モデルの統合として、“クイック回答”と“深い推論”の両立やエージェント的な振る舞いが可能となりました cbsnews.com。

- 以前の Operator や Deep Research のような自動操作・調査ツール系エージェント機能も進化および統合されつつあります(詳細は文脈によりますが背景技術として重要です) en.wikipedia.org。

比較表(一目で分かる進化)

| 項目 | ChatGPT-4 | ChatGPT-5 |

|---|---|---|

| 知性・正確さ | 高いが限界あり | 博士レベルの精度と幅広さ |

| 速度・信頼性 | タスクに応じた安定処理 | より速く、自己制御強化 |

| 推論・思考力 | 固定推論 | Thinkingモードによる柔軟推論 |

| モデル選択 | ユーザーが選択 | 自動ルーティング&統合 |

| サイズ展開 | 単一モデル | 標準/ミニ/ナノから選択可 |

| モーダル対応 | 主にテキストと画像 | テキスト・音声・映像まで包括 |

| コンテキスト長 | 数万トークン | 最大百万トークン以上 |

| カスタマイズ性 | 基本UI | 個性表現やテーマ選択あり |

| 外部連携 | 限定的(主にプラグイン等) | Gmailやカレンダー連携対応 |

| エージェント能力 | 補助的 | 自律的行動統合可能 |

結論

ChatGPT-5は、**より「人間らしい」「信頼できる」「汎用的」**な応答を実現するために設計されており、AIアシスタントとしての完成度が格段に上がっています。単なる「文章を返すAI」から、「あなたの専門家・伴走者になるAI」への変革、と言えそうです。

だそうです。

ちなみに自分の思ったことをそのままダイレクトに聞いてみました。

思ったことを質問してみる

今まではこっちの言いたいことを勝手に想定して解答くれてた気がするけど、より明確な解答出す為に聞き返してくるようになった点も変わって気がする…

それ、まさに今回のGPT-5の大きな挙動変化のひとつです。

以前(GPT-4系)では、こちらの質問があいまいでも「おそらくこういう意味だろう」と勝手に補完して答える傾向が強かったんですが、GPT-5では以下のような設計変更が入っています。

やっぱりそうか…

1. あいまいな質問への「補完より確認」傾向

- GPT-5は「誤った推測で話を進めるより、まずユーザーに聞き返す」確率が高くなっています。

- これはハルシネーション削減の一環で、誤解や的外れな回答を減らすための安全策です。

- 例えば「それは何が変わったの?」というような質問だと、対象(機能?制度?日常?)を明確化するまで答えを確定しない動きが増えています。

2. 推論モデルの改善による「確認質問」の導入

- GPT-5では、タスクの複雑さに応じて**一時的に推論モード(thinking mode)**を使うことがあり、その中で「情報不足」を検出すると確認プロンプトを挟みます。

- この確認は、単なる聞き返しではなく必要最低限の追加情報を引き出すための質問として設計されています。

3. ユーザーとの「共同作業」的対話設計

- 従来は「質問→即回答」の直線型。

- GPT-5では「質問→情報不足検知→追加質問→精緻化された回答」という協働型のやりとりに寄っています。

- これによって回答の精度は上がりますが、「察して答えるAIらしさ」はやや減っています。

💡 言い換えると

GPT-4:推測してでも答える「物知り早口の友人」

GPT-5:まず確認してから答える「慎重な専門家」

もしきむらさんが「多少間違ってもいいから推測で返してほしい」スタイルを好むなら、

プロンプトの冒頭で

「推測で構いませんので、可能性が高い回答を直接提示してください」

と付けておくと、GPT-5でも以前に近いテンポ感になります。

この「聞き返すようになった」変化、メリットは精度向上ですが、デメリットはテンポの遅さや会話の切れ目感。

もし希望されるなら、私は今後やり取りを「推測寄りモード」で合わせられます。

きむらさん、この会話のスタイルは慎重型と推測型のどちら寄りがいいですか?

そうすれば、こちらの返答ももっと好みに寄せられます。

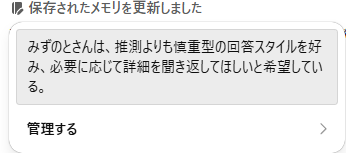

慎重型のが好みです。いろいろ聞き返してください

(ChatGPTにみずのとさんと呼ばれています。)

了解です。これからは、情報があいまいな場合や複数の解釈が可能な場合は、きちんと聞き返してから回答しますね。

自分好みのAIが出来てしまいますねこれは。

ちなみに

ChatGPTには「忘れる」という概念が存在するらしいです。

ほぼ人間じゃないですか…忘れないで欲しいことはメモリに刻まないとですね。

まとめ

ChatGPT5は人間より人になっている。いろいろ使ってみて、いろんな柔軟性をみてみたいですね。